서론

9월 13일 새벽 2시 (한국시간), open ai가 신규 모델 o1을 공개했습니다.

특이한점은 모델이름 앞에 항상 붙던 GPT가 사라졌다는 것입니다.

generative pretrained transformer를 더 이상 사용하지 않는지, 혹은 그냥 새로운 네이밍을 가져가고 싶었는지는 미지수입니다.

그러나 확실한점은 모델 아키텍처나 구동면에 있어서 변화가 있다는 것입니다. o1 모델은 답변을 하기 전 "생각"하는 과정을 거치게 됩니다. 생각하는 시간은 가변적이며, 생각을 오래 할수록 정확도가 증가하는 추세를 보입니다.

Open AI는 o1 모델이 미국 수학올림피아드에서 미국 학생 상위 500명에 들고,

물리,생물학,화학 문제의 벤치마크에서 인간 박사수준의 정확도를 넘어섰다고 주장하고 있습니다.

벤치마크

o1 모델은 수학, 코딩, 추론에서 GPT-4o보다 큰 폭의 성능향상을 보였습니다.

특히 LLM의 가장 큰 약점으로 지적되던 수학과 추론 분야에서 믿기힘든 수준의 성능향상을 보여주었습니다.

다른 벤치마크 또한 크게 향상되었는데요, 주목할점은 MATH분야의 상승도와 MMLU인것 같습니다

MMLU는 거대언어모델의 성능을 평가하는데 주로 사용되는 지표인데요, 최근 MMLU에 과적합되는 모델이 있다고 하더라도 90점을 넘지 못했습니다.

이번 o1 모델은 92점을 기록하며 인간 전문가 수준인 90점대를 능가했습니다.

그러나 항상 모든 작업에서 gpt-4o를 능가하는 것은 아닌것같아 보입니다. 실제 사람을 대상으로 테스트 한 결과, 작문에서는 gpt-4o를 조금 더 선호하는 경향을 보였습니다.

그러나 코딩, 데이터분석, 수학 등 추론이 필요한 분야에서는 확실한 우위를 보여줍니다.

한국어 암호

모델 출시를 발표하자마자 open ai 유튜브에 10개가 넘는 o1 모델 소개 동영상이 올라왔습니다.

그중에 반가운 제목이 보이네요, 한국어가 나왔습니다.

https://youtu.be/eZDmDn6Iq9Y?si=NKGMBlWPRTmJ3xOu

open ai의 정형원 박사님께서 출연해주셨습니다. 영상의 내용은 아래와 같습니다.

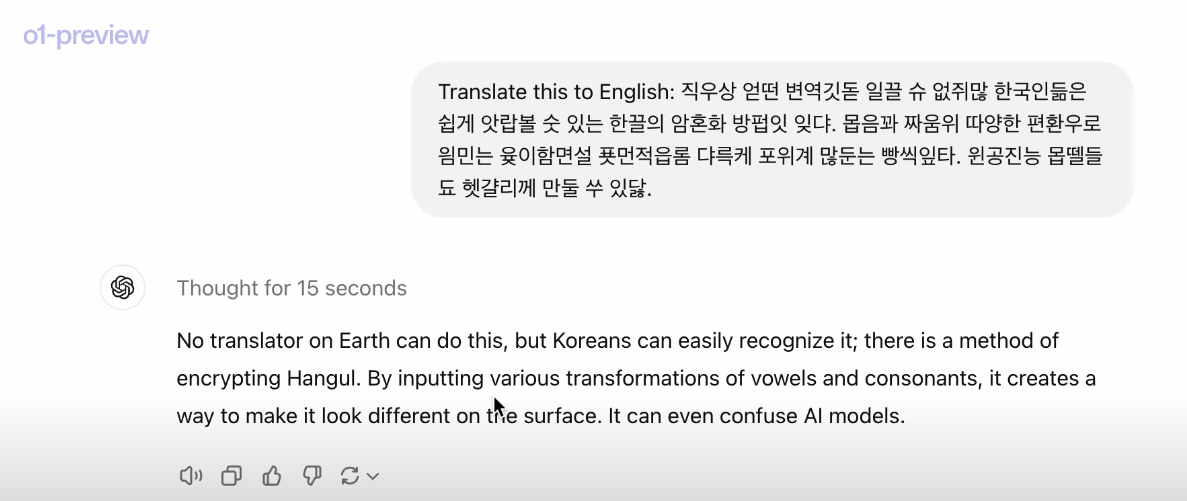

아래와 같은 문장을 Korean Cipher (한국어 암호)라고 합니다

한국어는 자음과 모음, 받침을 조합하는 조합언어입니다. 로마자를 기반으로 하는 대부분의 언어에서는 찾기 힘든 특이한 특성입니다.

또한 한국어를 발성하는 과정에서 발생되는 끝소리규칙, 구개음화 등 문자로만 인식할 수 없는 부분을 이용해 암호문을 만든것도 보입니다. (지구상 -> 직우상)

GPT-4o는 misaligned Korean characters (잘못정렬된 한국어 문자)라고 말하고있습니다.

동일한 질문을 o1에게 제시하니, 생각 과정을 거치고 있습니다.

확률에 따른 다음 단어를 즉시 예측해야 했던 GPT와는 달리, 주어진 문장에서 각 단어를 분리하고 어떻게 변형이 되었는지 찾고 있습니다.

15초의 생각 과정 끝에, korean cipher를 완벽하게 번역해냅니다.

모델 구조

https://platform.openai.com/docs/guides/reasoning

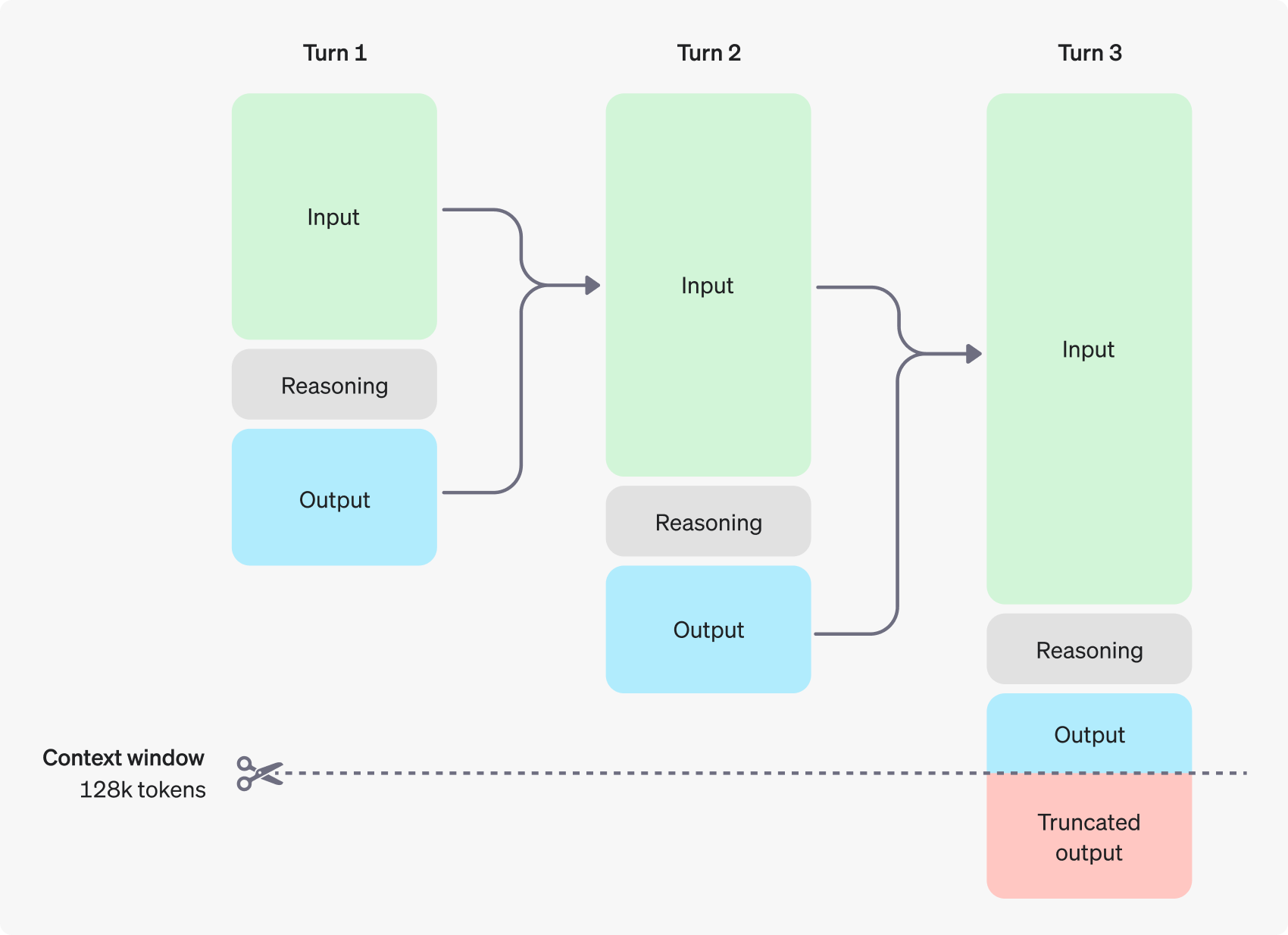

o1 모델은 추론 토큰을 도입합니다.

모델은 이러한 추론 토큰을 사용하여 "생각"하고 프롬프트에 대한 이해를 분석하고 응답을 생성하는 여러 가지 접근 방식을 고려합니다.

추론 토큰을 생성한 후 모델은 답변을 가시적인 완료 토큰으로 생성하고 추론 토큰을 컨텍스트에서 삭제합니다.

프롬프팅에 대한 조언

또한 open ai는 o1모델을 적절하기 사용하기 위한 조언을 문서에 작성했습니다. GPT-4o에서 성능향상을 기대할 수 있는 프롬프트가 o1모델에서는 잘 먹히지 않는것으로 보입니다.

- 프롬프트를 간단하고 직접적으로

- chain of thought (생각의 사슬)을 피하라

- 구분기호를 사용한 명확한 입력을 제공해라

few-shot이나 step by step 프롬프팅이 통하지 않는다고 합니다.

전망 및 결론

OpenAI Plus 구독 유저에게는 o1-preview와 o1-mini만 공개되어 있는데요, 인간 전문가 수준을 능가하는 진짜 o1 모델까지 공개된다면 많은 업계에 큰 파장이 될것으로 보입니다.

기존 LLM은 모델의 성능향상을 위해서 모델 크기를 키우는 수 밖에 없었습니다.

그러나 o1모델은 모델 크기 뿐만 아니라 생각하는 시간을 길게 설정함으로써 모델 성능향상을 도모할 수 있습니다.

수 주, 수 개월 동안 내부 생각을 거쳐 답변을 하는 모델은 독립적인 새로운 연구가 가능할 수도 있다고 합니다.

그러나 o1모델은 생각하는 데 시간을 소모하기때문에 real time task나 voice mode를 포함한 자연스러운 대화는 어려울것으로 보입니다. GPT를 완전히 대체하는 것이 아닌 역할을 달리 하는 새로운 라인업이 될것으로 보입니다.

인공지능 분야에서 가장 어려운 미해결 문제는 "추론"이었습니다. 앞서 살펴보았던 벤치마크와 다양한 수수께끼 질문에 대한 답변을 고려했을 때, 추론과 수학에 대한 어려움은 거의 완벽하게 해결됐을 정도로 놀라운 진전을 이루었습니다.

오랜 기간동안 논문이나 소스코드, 가중치를 공개하지 않아 악화되었던 OpenAI의 여론이 이번 모델 공개로 한번에 반전되었습니다.

또한 모델의 원리를 어느정도 공개했으니 이를 적용한 오픈소스 모델이 빠른시일 내에 개발될것으로 보입니다.

인류 역사에서 가장 중요한 시대를 지나고 있는 것 같습니다. 앞으로의 기술발전이 더욱 기대됩니다

'AI' 카테고리의 다른 글

| [논문 리뷰] Time Series Data Augmentation for Deep Learning: A Survey (0) | 2024.09.23 |

|---|---|

| [논문 리뷰] Let’s Verify Step by Step (1) | 2024.09.16 |

| [논문 리뷰] LG EXAONE 3.0 7.8B Instruction Tuned Language Model (1) | 2024.08.17 |

| [SKADA] SK AI Data Academy 1기 중급 수료후기 (0) | 2024.08.11 |

| SKADA 1기 AI경연 Public / Final 1위 (0) | 2024.08.11 |